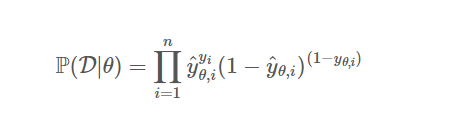

이 논문은 2개월 전에 나와서 리뷰가 많이 없었다. 하지만, 기존 transformer을 대체할 수 있는 논문으로 소개 되고 있음유튜브로 설명 찾아봤는데, 아직 한국분이 리뷰한 영상은 없는 듯인도인 분 영상 + 세미나 발표 준비겸 직관 대로 정리한 pdf파일 참고하면 될 것 같습니다.핵심은 Long term Memory에서 test time에서도 학습이 진행되며, 정보 검색(read, write)이 어떻게 이루어지는지 설명했습니다.4학년 학부생이 만든 pdf여서 틀릴 수도 있습니다 ! Introduction 본 논문에서 기존 transformer attention 구조의 문제를 어떤 idea로 해결하는가를 다룸Related Work기존 attention 관점을 -> 메모리 관점으로 변환하기 전 관련 수식..